Privacy Paradox

Obwohl aktuelle Umfrageergebnisse zeigen, dass der Schutz ihrer personenbezogenen Daten ein wichtiges Thema für Online-Nutzer weltweit ist, unternehmen die meisten Nutzer selten Anstrengungen, diese Daten aktiv zu schützen und geben sie oft sogar freiwillig weiter. Privacyforscher haben bereits mehrfach versucht, dieses scheinbare Paradox zwischen Privatsphäre-Einstellung und Privatsphäre-Verhalten zu erklären, das üblicherweise als "Privacy Paradox" bezeichnet wird. Obwohl bereits mehrere theoriebasierte Erklärungen für das Privacy Paradox postuliert wurden sowie empirische Studienergebnisse zu einzelnen Faktoren vorliegen, die einen Einfluss auf das Privatsphäre-Verhalten und die Privatsphäre-Einstellung ausüben, wurde bisher keine umfassende Erklärung für das Privacy Paradox gefunden. Wir wollen das Privacy Paradox daher näher beleuchten, indem wir die populärsten theoretischen Erklärungsansätze bzgl. des Privacy Paradox zusammenfassen und die Faktoren identifizieren, die für die Vorhersage von Privatsphäre-Einstellung und Privatsphäre-Verhalten am relevantesten sind. Da sich viele Studien auf die Verhaltensabsicht und nicht auf das tatsächliche Verhalten konzentrieren, haben wir uns entschieden, auch dieses Thema zu berücksichtigen.

Forschungsmethode

Basierend auf einem Literatur-Review identifizieren wir alle Faktoren, die einen der drei Privatsphäreaspekte (Einstellung, Verhalten, Verhaltensabsicht) signifikant vorhersagen und berichten die standardisierte Effektstärke (ß). Die Ergebnisse sprechen für die theoretische Erklärung, die als "Privacy Calculus" bezeichnet wird, da die potenziellen Gewinne unter den Faktoren mit der besten Vorhersageleistung für die Absicht, Informationen preiszugeben, ist. Andere gute Prädiktoren für das Privatsphäreverhalten sind die Privatsphäre-Intention, die Bereitschaft, Daten preiszugeben, die Privatsphärebedenken und die Privatsphäre-Einstellung. Demografische Variablen spielen nur eine untergeordnete Rolle, einzig das Geschlecht sagt das Privatpshäre-Verhalten schwach hervor. Die Privatpshäre-Einstellung wird am besten von internen Variablen wie dem Vertrauen gegenüber der Website, den Privatsphäre-Bedenken und der Computerängstlichkeit vorhergesagt. Obwohl etliche Studien zum Thema Endnutzer-Privatsphäre durchgeführt wurden, ist es nicht einfach, ein abschließendes Fazit zu ziehen, da die Autoren häufig Bezug auf leicht unterschiedliche Konstrukte nehmen. Wir schlagen deshalb vor, dass sich die Forschungsgemeinschaft in diesem Feld auf eine einheitliche Definition der verschiedenen Privatsphäre-Kontrukte einigt, um es zu ermöglichen, dass Schlüsse über verschiedene individuelle Stichproben und Studiendesigns hinweg gezogen werden können.

Wir versuchen, auf dieser Seite einen Überblick über das Thema zu geben. Weitere Informationen können hier gefunden werden: Explaining the privacy paradox: A systematic review of literature investigating privacy attitude and behavior: Nina Gerber, Paul Gerber, Melanie Volkamer. Computers & Security, Volume 77, August 2018, Pages 226-261.

Der folgende Abschnitt berschreibt die populärsten bisher postulierten Erklärungsansätze für das Privacy Paradox. Ein weiteres Review von Erklärungsansätzen findet sich bei Kokolakis (2017).

Privacy Calculus

Eine der am weitesten verbreiteten Erklärungen für das Privacy Paradox basiert auf dem theoretischen Konzept des "homo oeconomicus". In den Wirtschaftswissenschaften bezieht sich der Begriff "Homo oeconomicus" auf den Prototyp eines ökonomischen Menschen, eines Verbrauchers, dessen Entscheidungen und Handlungen alle vom Versuch geleitet werden, seinen Nutzen zu maximieren (Rittenberg und Trigarthen, 2012; Flender und Müller, 2012). Angewandt auf den Datenschutz besagt dieses Konzept, dass ein Nutzer die Vorteile, die durch die Preisgabe von Daten erzielt werden könnten, mit den Kosten verrechnet werden, die durch die Preisgabe seiner Daten entstehen könnten (Lee und Kwon, 2015). Typische Vorteile der Weitergabe privater Daten sind finanzielle Rabatte (z.B. durch die Teilnahme an Kundenbindungsprogrammen), erhöhter Komfort (z.B. durch die Hinterlegung von Kreditkartendaten bei einem Online-Händler) oder soziale Vorteile (z.B. durch die Nutzung sozialer Netzwerke und Messenger) (Wang et al., 2015; Wilson und Valacich, 2012). Die Kosten für die Preisgabe von Daten sind dagegen weniger greifbar und beinhalten alle möglichen Risiken und negativen Folgen (z.B. Sicherheitsrisiken, Identitätsdiebstahl, unbeabsichtigte Nutzung durch Dritte oder soziale Kritik und Demütigung) (Warshaw et al., 2015). Nach dem Privacy Calculus wird von einem Nutzer erwartet, dass er seine Daten bereitwillig weitergibt, wenn der erwartete Nutzen der Preisgabe die Kosten übersteigt (Lee und Kwon, 2015). Dennoch kann er/sie weiterhin Bedenken bzgl. des Verlustes seiner/ihrer Daten äußern, was zu der beobachteten Diskrepanz zwischen den geäußerten Bedenken bzw. der Einstellungen und dem tatsächlichen Verhalten führt.

Bounded Rationality & Decision Biases

Das oben beschriebene Modell postuliert die Existenz eines rationalen Nutzers, der begründete Trade-off-Analysen für die Entscheidung, seine Daten zu teilen (oder zu schützen), durchführt. Zahlreiche Studien zum Entscheidungsverhalten von Nutzern haben jedoch gezeigt, dass der Entscheidungsprozess von verschiedenen kognitiven Vorurteilen und Heuristiken beeinflusst wird (Acquisti und Grossklags, 2007; Knijnenburg et al., 2013). So ist es beispielsweise unwahrscheinlich, dass jeder Nutzer bei einer Privatsphäre-Entscheidung auf umfassende Informationen über alle möglichen Kosten und Nutzen zugreifen kann (im Gegenteil, die Nutzer wissen häufig nicht einmal, dass ihre Daten erhoben werden (Wakefield, 2013)). Ihre Entscheidung basiert daher auf unvollständigen Informationen, die zu einer Über- oder Unterschätzung der Kosten und Nutzen führen können und daher für einen externen Beobachter irrational, für den Entscheidungsträger aber gleichzeitig ziemlich rational erscheinen können (Flender und Müller, 2012). Darüber hinaus ist die menschliche Fähigkeit zur kognitiven Verarbeitung bis zu einem gewissen Grad eingeschränkt, d.h. selbst wenn ein Nutzer Zugang zu allen notwendigen Informationen hat, fehlt ihm möglicherweise die Fähigkeit, alle diese Informationen korrekt zu verarbeiten und eine fundierte Entscheidung zu treffen (Deuker, 2011). In der Literatur wird dieser Effekt oft als "bounded rationality" bezeichnet (Flender und Müller, 2012; Knijnenburg et al., 2013). Die daraus resultierenden unvollkommenen Entscheidungen gehen oft auf kognitive Verzerrungen zurück, weil der Entscheidungsträger bestimmte Heuristiken einsetzt, um seine begrenzte Rationalität zu kompensieren (Kokolakis, 2017; Symantec 2015; Wakefield, 2013; Zafeiropoulou et al., 2013; Tversky und Kahneman, 1974). Daher spiegelt das resultierende Verhalten möglicherweise nicht die ursprüngliche Absicht oder die geäußerte Einstellung zu diesem Verhalten wider. Beliebte Beispiele für diese kognitiven Vorurteile sind:

-

Die Verfügbarkeitsheuristik: Menschen neigen dazu, die Wahrscheinlichkeit von Ereignissen zu überschätzen, an die sie sich leicht erinnern können, z.B. weil sie in den Medien sehr präsent sind (Schwarz et al., 1991).

-

Der Optimismus Bias: Die Menschen neigen dazu zu glauben, dass sie einem geringeren Risiko ausgesetzt sind, einr negative Privatsphäre-Erfahrung zu machen als andere (Cho et al., 2010).

-

Der Bestätigungs Bias: Menschen neigen dazu, nach Informationen zu suchen oder sie so zu interpretieren, dass ihre Überzeugungen und Annahmen bestätigt werden (Plous, 1993).

-

Die Affektheuristik: Menschen beurteilen schnell anhand ihrer affektiven Eindrücke und unterschätzen damit die Risiken von Dingen, die sie mögen, und überschätzen die Risiken von Dingen, die sie nicht mögen (Slovic et al., 2002).

-

Der Bias der unmittelbaren Befriedigung, der manchmal auch als "hyperbolic discounting" bezeichnet wird: Die Menschen schätzen die gegenwärtigen Vorteile oder Risiken tendenziell höher ein als die, die in der Zukunft liegen (Acquisti und Grossklags, 2003)

-

Der Valenzeffekt: Die Menschen neigen dazu, die Wahrscheinlichkeit positiver Ereignisse zu überschätzen (Gold und Braun, 2009).

-

Der Framing-Effekt: Je nachdem, wie eine Frage gestaltet oder Informationen präsentiert werden, reagieren die Menschen unterschiedlich (Tversky und Kahneman, 1981).

-

Das Phänomen der rationalen Unwissenheit: Die Menschen ignorieren die potenziellen Kosten des Datenaustausches, da die Kosten für deren Erlernen, z.B. durch das Lesen der Datenschutzrichtlinien, höher wären als der erwartete Nutzen aus dem Austausch der Daten (Downs, 1957).

Fehlende persönliche Erfahrung und Schutzwissen

Eine weitere Erklärung bietet die Tatsache, dass nur wenige Benutzer tatsächlichnegative Privatsphäreerfahrungen gemacht haben. Infolgedessen basieren die meisten Privatsphäre-Einstellungen auf Heuristiken oder Erfahrungen Dritter. Allerdings führen nur persönliche Erfahrungen zu einer EInstellung, die stabil genug ist, um das entsprechende Verhalten maßgeblich zu beeinflussen (Dienlin und Trepte, 2015). Neben dem daraus resultierenden schwachen Zusammenhang zwischen Einstellung und Verhalten fehlt manchen Nutzern möglicherweise einfach die Fähigkeit, ihre Daten zu schützen, weil sie keine oder nur begrenztes Wissen über technische Lösungen wie das Löschen von Cookies, die Verschlüsselung von E-Mails oder die Anonymisierung von Kommunikationsdaten haben, z.B. durch den Einsatz der Tor-Software (Baek, 2014).

Soziale Einflüsse

Die meisten Menschen sind nicht autonom in ihrer Entscheidung, die Nutzung eines Messaging-Dienstes, eines sozialen Netzwerks oder einer E-Mail-Verschlüsselungssoftware zu akzeptieren oder abzulehnen. Es wird vielmehr davon ausgegangen, dass das soziale Umfeld eines Individuums seine Persönlichkeitsentscheidungen und sein Verhalten maßgeblich beeinflusst (Taddicken, 2014). Besonders in kollektivistischen Kulturen, in denen Individuen ein starkes "wir"-Bewusstsein besitzen, gehorchen die Nutzer sozialen Normen (Beldad und Citra Kusumadewi, 2015). Aber auch in individualistischen Kulturen tritt sozialer Einfluss auf, z.B. wenn sich Jugendliche beim Datenaustausch in sozialen Netzwerken an das Beispiel ihrer Eltern anpassen (Van Gool et al., 2015). In beiden Arten von Kultur orientieren sich Individuen in der Regel zumindest bis zu einem gewissen Grad an der (vermeintliche) Meinung und dem Verhalten ihrer Altersgenossen und/oder Familienmitglieder bei ihrer Entscheidung, eine bestimmte Technologie zu verwenden oder ihre Daten offenzulegen. Wenn wichtige Bezugspersonen dazu neigen, private Daten selbst preiszugeben, z.B. in sozialen Netzwerken, kann eine Art von sozialem Druck auftreten, der auf einer Idee der Gegenseitigkeit aufbaut, d.h. "wenn die anderen Daten preisgeben, wäre es unfair, dies nicht zu tun" (Flender und Müller, 2012). Manchmal kann die Entscheidung, keine personenbezogenen Daten weiterzugeben, sogar zu einem sozialen Stigma werden, denn wer sich weigert, seine Gewohnheiten, Handlungen und Einstellungen offen zu legen, muss "etwas Schreckliches zu verbergen haben" (Hull, 2015). Daher wird das tatsächliche Verhalten höchstwahrscheinlich von sozialen Faktoren beeinflusst, während die geäußerte Einstellung eher die tatsächliche Meinung des jeweiligen Individuums widerspiegelt.

Das Risiko- und Vertrauensmodell

Es ist sehr wahrscheinlich, dass das wahrgenommene Risiko der Datenweitergabe sowie die Vertrauenswürdigkeit des Empfängers die Einstellung und das Verhalten einer Person zum Datenaustausch beeinflussen. Einige Autoren erklären das Privacy Paradox, indem sie davon ausgehen, dass Vertrauen einen direkten Einfluss auf das Datenschutzverhalten hat, während das wahrgenommene Risiko die Einstellung und Verhaltensabsicht beeinflusst. Dennoch ist dieser Einfluss nicht stark genug, um das tatsächliche Verhalten zu beeinflussen (Norberg et al., 2007). Vertrauen wirkt sich in konkreten Entscheidungssituationen (z.B. Verhalten) stärker aus. Das wahrgenommene Risiko hingegen dominiert in abstrakten Entscheidungssituationen, z.B. wenn ein Nutzer gefragt wird, ob er bereit wäre, seine Daten in einer hypothetischen Situation zu teilen (Flender und Müller, 2012), wodurch die Dichotomie zwischen der geäußerten Einstellung und dem tatsächlichen Verhalten entsteht.

Quantentheorie

Auf der Grundlage der Quantentheorie schlagen Flender und Müller (2012) eine weitere Erklärung für das Privacy Paradox vor. Wenn die menschliche Entscheidungsfindung den gleichen Effekten unterliegt wie der Messprozess in Quantenexperimenten, können wir davon ausgehen, dass das Ergebnis eines Entscheidungsprozesses erst nach der eigentlichen Entscheidung bestimmt wird (Kokolakis, 2017) und zwei Entscheidungen in Bezug auf die Entscheidungsfindung nicht austauschbar sind (Flender und Müller, 2012). Wenn eine Person also vor der eigentlichen Entscheidung nach einem möglichen Entscheidungsergebnis gefragt wird (d.h. es wird eher die Einstellung als das Verhalten bewertet), spiegelt ihre Antwort nicht unbedingt das tatsächliche Entscheidungsergebnis wider.

Illusion der Kontrolle

Brandimarte et al. (2013) haben sich in einer Reihe von Studien mit der Hypothese beschäftigt, dass Nutzer beim Umgang mit dem Schutz ihrer Daten unter einer "Illusion der Kontrolle" leiden. Sie stellten fest, dass die Nutzer die Kontrolle über die Veröffentlichung von Informationen tatsächlich mit der Kontrolle über die Bewertung dieser Informationen durch Dritte zu verwechseln scheinen. Daher ist es wahrscheinlicher, dass die Nutzer die Veröffentlichung personenbezogener Daten gestatten und sogar sensiblere Informationen bereitstellen, wenn sie die ausdrückliche Kontrolle über die Veröffentlichung ihrer Daten erhalten. Wenn hingegen ein Dritter für die Veröffentlichung derselben Daten verantwortlich ist, können Nutzer einen Kontrollverlust wahrnehmen und Bedenken hinsichtlich der unbefugten Nutzung ihrer Daten durch andere äußern (Brandimarte et al., 2009). Nach dieser Hypothese wird das paradoxe Verhalten durch das falsche Gefühl der Kontrolle über die weitere Verwendung privater Daten verursacht, das auftritt, wenn die Nutzer zunächst über die Veröffentlichung entscheiden können (z.B. durch Veröffentlichung in sozialen Netzwerken und Verwaltung der Datenschutzeinstellungen für den Beitrag).

Das Privacy Paradox als methodisches Artefakt

Ein weiterer möglicher Grund für die Dichotomie zwischen Verhalten und Einstellung liegt in methodischen Überlegungen. Eine Erklärung könnte die unangemessene Operationalisierung dieser Konstrukte in den einzelnen Studien zum Paradoxon des Datenschutzes sein (Dienlin und Trepte, 2015). Verhalten wird oft als dichotome Antwort bewertet (z.B. indem man fragt, ob jemand ein öffentliches Facebook-Profil hat oder nicht), während die Einstellung auf einer metrischen (z.B. einer Likert-basierten) Skala gemessen wird. Dichotome Daten implizieren jedoch immer eine mögliche Begrenzung der Varianz, was wiederum zu einer Reduzierung der statistischen Power führen kann. Daher ist es möglich, dass es in der Tat eine starke Beziehung zwischen Einstellung und Verhalten gibt und frühere Studien diese Beziehung aufgrund ihrer unangemessenen Operationalisierung einfach nicht verifizieren konnten.

Ein weiterer Ansatz basiert auf der Annahme einer mehrdimensionalen Natur der Privatsphäre. Dienlin und Trepte (2015) postulieren, dass es wichtig ist, zwischen der Privatsphäre-Einstellung und den Privatsphäre-Bedenken einerseits und der informationellen, sozialen und psychologischen Privatsphäre andererseits zu unterscheiden. Tatsächlich ergab eine entsprechende Studie von Dienlin und Trepte (2015), die diese verschiedenen Facetten der Privatsphäre berücksichtigt, einen indirekten Effekt der Privatsphäre-Bedenken auf das Privatsphäre-Verhalten. Insbesondere hatten Privatsphäre-Bedenken Auswirkungen auf die Privatsphäre-Einstellung, was wiederum die Privatsphäre-Intention beeinflusste, was schließlich das Privatsphäre-Verhalten beeinflusste.

Bislang wurde keine eindeutige Erklärung für das Privacy Paradox gefunden. Angesichts der Vielzahl möglicher Erklärungen für das Privacy Paradox, seien es theoretische Erklärungen oder die Entwicklung umfangreicher Modelle, die es näher beleuchten, sollte die Dichotomie zwischen Privatsphäre-Einstellungen, -Bedenken oder wahrgenommenem Risiko und Privatsphäre-Verhalten jedoch nicht mehr als Paradoxon wahrgenommen werden. Um besser zu verstehen, welche Faktoren einen Einfluss auf den Umgang von Nutzern mit ihrer Privatsphäre ausüben, berichten wir in unserem Paper die standardisierte Effektgröße (β), die in den betrachteten Studien zum Zusammenhang der verschiedenen Prädiktorvariablen mit Privatsphäre-Einstellung, Privatsphäre-Bedenken, wahrgenommenem Privatsphäre-Risiko, Privatsphäre-Intention und dem Privatsphäre-Verhalten gefunden wurden.

Referenzen

Acquisti A ,Grossklags J . Losses, gains, and hyperbolic discounting: an experimental approach to information security attitudes and behavior. Proceedings of the second annual workshop on economics and information security (WEIS 2003), 2003

Acquisti A ,Grossklags J . What can behavioral economics teach us about privacy?. In: Acquisti A, Gritzalis S, Lambrinoudakis C, di Vimercati S, editors. Digital privacy: theory, technology, and practices. Boca Raton: Auerbach Publications; 2007. p. 363–77

Baek YM. Solving the privacy paradox: a counter-argument experimental approach. Comput Hum Behav 2014;38:33–42. doi: 10.1016/j.chb.2014.05.006

Beldad A, Citra Kusumadewi M. Here’s my location, for your information: the impact of trust, benefits, and social influence on location sharing application use among Indonesian university students. Comput Hum Behav 2015;49:102–10. doi: 10.1016/j.chb.2015.02.047

Brandimarte, L., Acquisti, A., Loewenstein, G. (2009). Privacy concerns and information disclosure: an illusion of control hypothesis. In: Proceedings of the poster iConference

Brandimarte L, Acquisti A, Loewenstein G. Misplaced confidences: privacy and the control paradox. Soc Psychol Personal Sci 2013;4(3):340–7. doi: 10.1177/1948550612455931

Cho H ,Lee JS ,Chung S . Optimistic bias about online privacy risks: testing the moderating effects of perceived controllability and prior experience. Comput Hum Behav 2010;26(5):987–95

Dienlin T, Trepte S. Is the privacy paradox a relic of the past? An in-depth analysis of privacy attitudes and privacy behaviors. Eur J Soc Psychol 2015;45(3):285–97. doi: 10.1002/ejsp.2049

Downs A . An economic theory of democracy. New York: Harper & Brothers; 1957

Flender C ,Müller G . Type indeterminacy in privacy decisions: the privacy paradox revisited. In: Busemeyer JR, Dubois F, Lambert-Mogiliansky A, Melucci M, editors. Quantum interaction. Berlin Heidelberg: Springer; 2012. p. 148–59

Gold RS, Brown MG. Explaining the effect of event valence on unrealistic optimism. Psychol Health Med 2009;14(3):262–72. doi: 10.1080/13548500802241910

Hull G. Successful failure: what Foucault can teach us about privacy self-management in a world of Facebook and big data. Ethics Inf Technol 2015;17(2):89–101. doi: 10.1007/s10676-015-9363-z

Knijnenburg BP, Kobsa A, Jin H. Dimensionality of information disclosure behavior. Int J Hum Comput Stud 2013;71(12):1144–62. doi: 10.1016/j.ijhcs.2013.06.003

Kokolakis S. Privacy attitudes and privacy behaviour: a review of current research on the privacy paradox phenomenon. Comput Secur 2017;64:122–34. doi: 10.1016/j.cose.2015.07.002

Lee N, Kwon O. A privacy-aware feature selection method for solving the personalization-privacy paradox in mobile wellness healthcare services. Expert Syst Appl 2015;42(5):2764–71. doi: 10.1016/j.eswa.2014.11.031 .

Norberg PA, Horne DR, Horne DA. The privacy paradox: personal information disclosure intentions versus behaviors. J Consum Affairs 2007;41(1):100–26. doi: 10.1111/j.1745-6606.2006.00070.x

Plous S . The psychology of judgment and decision making. New York: McGraw-Hill Inc; 1993

Rittenberg L ,Trigarthen T . Principles of microeconomics. Washington, DC: Flat World Knowledge, Inc.; 2012

Schwarz N ,Bless H ,Strack F ,Klumpp G ,Rittenauer-Schatka H ,Simons A . Ease of retrieval as information: another look at the availability heuristic. J Personal Social Psychol 1991;61:195–202

Slovic P ,Finucane M ,Peters E ,MacGregor GD . The affect heuristic. In: Gilovich T, Griffin WD, Kahneman D, editors. Heuristics and biases. Cambridge University Press; 2002. p. 397–420

Symantec (2015). State of privacy report 2015 . Symantec. http://www.symantec.com/content/en/us/about/presskits/ b- state- of- privacy-report-2015.pdf/ Accessed01March 2017

Taddicken M. The “privacy paradox”in the social web: the impact of privacy concerns, individual characteristics, and the perceived social relevance on different forms of self-disclosure. J Comput Mediat Commun 2014;19(2):248–73. doi: 10.1111/jcc4.12052

Tversky A ,Kahneman D . Judgement under Uncertainty: Heuristics and Biases. Science 1974;185(4157):1124–31

Tversky A, Kahneman D. The framing of decisions and the psychology of choice. Science 1981;211(4481):453–8. doi: 10.1126/science.7455683

Van Gool E, Van Ouytsel J, Ponnet K, Walrave M. To share or not to share? Adolescents’ self-disclosure about peer relationships on facebook: an application of the prototype willingness model. Comput Hum Behav 2015;44:230–9. doi: 10.1016/j.chb.2014.11.036

Wakefield R. The influence of user affect in online information disclosure. J Strateg Inf Syst 2013;22(2):157–74. doi: 10.1016/j.jsis.2013.01.003

Wang N, Zhang B, Liu B, Jin H. Investigating effects of control and ads awareness on android users’ privacy behaviors and perceptions. Proceedings of the seventeenth international conference on human–computer interaction with mobile devices and services; 2015. p. 373–82

Warshaw J, Matthews T, Whittaker S, Kau C, Bengualid M, Smith BA. Can an algorithm know the “real you”? Understanding people’s reactions to hyper-personal analytics systems. Proceedings of the thirty-third annual ACM conference on human factors in computing systems; 2015. p. 797–806

Wilson D ,Valacich J . Unpacking the privacy paradox: irrational decision-making within the privacy calculus. Proceedings of the thirty-third international conference on information systems; 2012. p. 4152–62 .Wisniewski P, Jia H, Xu H, Rosson

Zafeiropoulou AM, Millard DE, Webber C, O’Hara K. Unpicking the privacy paradox: can structuration theory help to explain location-based privacy decisions . Proceedings of the ACM Web Science Conference; 2013. p. 463–72

Model

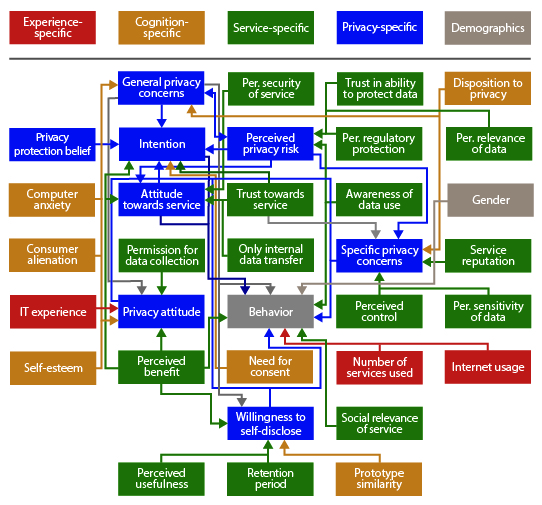

Die folgende Abbildung zeigt den Zusammenhang zischen den verschiedenen Variablen, die einen Einfluss auf Privatsphäre-Einstellung, -Verhalten und -Verhaltensintention ausüben.